A Regulação da Inteligência Artificial na Jurisprudência do Futuro: Responsabilidade Civil em Casos de Acidentes com Veículos Autônomos

*Recurso de imagem obtido a partir do site Freepik.com

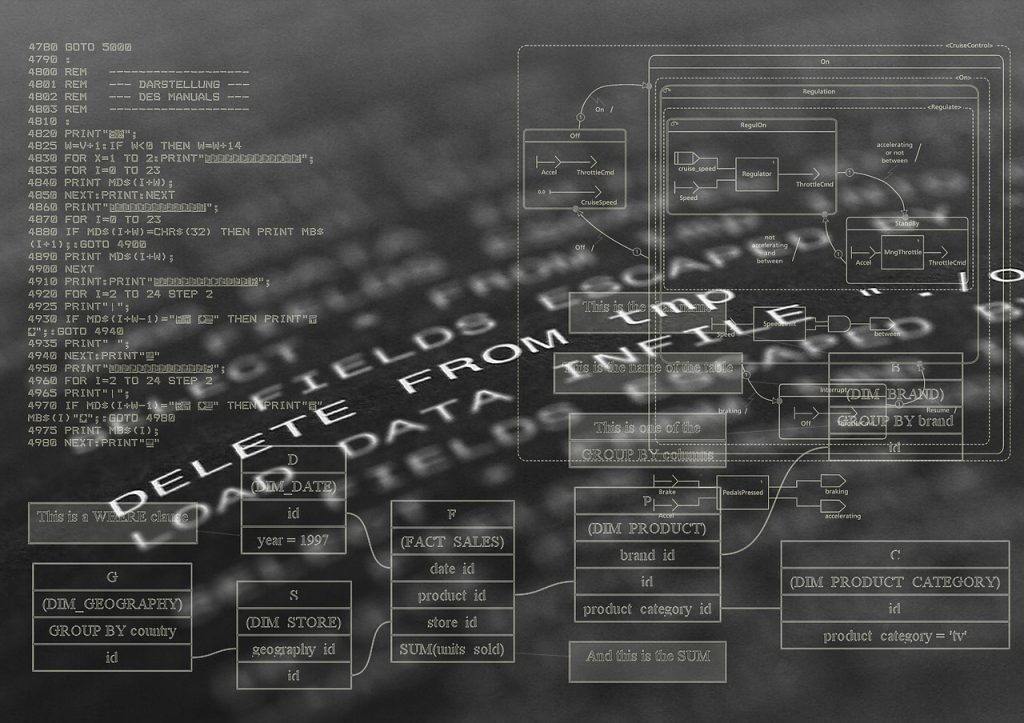

A rápida evolução da inteligência artificial (IA) e a sua aplicação em diversas áreas têm levantado questões éticas e jurídicas fundamentais relacionadas à atribuição de responsabilidade aos desenvolvedores e operadores desses sistemas. Recentemente, um júri estadunidense do Estado da California julgou improcedente pedido de indenização relacionado a acidente envolvendo veículo autônomo, em ação movida pelas vítimas do acidente.

Veículo autônomo é aquele que é capaz de se deslocar de forma independente, sem a intervenção humana direta para sua direção, que é realizada de forma automática por um sistema de inteligência artificial. A decisão considerou não haver demonstração de falhas no software do veículo, concluindo, portanto, que a empresa desenvolvedora do veículo não poderia ser responsabilizada pelos danos sofridos pela vítima. Fatores como a necessidade de supervisão do piloto automático pelo motorista foram alegados como argumentos de defesa.

O caso acende debates sobre a definição da responsabilidade civil em situações envolvendo o uso de sistemas de inteligência artificial e pode influenciar decisões futuras, inclusive no Brasil. Essas situações envolvem cenários complexos e com diversas particularidades a depender da aplicação do sistema, o que exige que a atribuição de responsabilidade demande uma avaliação que não seja restrita exclusivamente à presença de um sistema de inteligência artificial.

Nos Estados Unidos, ainda não há uma definição federal quanto ao regime jurídico de sistemas de IA, mas ocorre uma profusão de legislações no Estados voltadas à intersecção entre IA e proteção de dados. Quanto ao tema da responsabilidade civil em IA, os contornos da questão aguardarão a consolidação de precedentes judiciais.

No Brasil, a versão atual do Projeto de Lei nº 2.338/2023, que propõe regulamentar o uso da inteligência artificial no país, adota uma abordagem regulatória baseada no conceito de risco. No caso específico de veículos autônomos, esta aplicação é atualmente classificada como “alto risco”, demandando avaliação preliminar, avaliação de impacto algorítmico, e adoção de medidas de governança. Além disso, há atribuição objetiva de responsabilidade por danos causados, ou seja, apenas é necessária a caracterização dos elementos do fato, dano e nexo causal, prescindindo de comprovação a culpa. Nessa hipótese, traz como excludentes de responsabilidade comprovação pelos agentes de IA de inexistência de vínculo entre o dano e eventual falha do sistema de IA ou de que o dano decorre exclusivamente de fato da vítima ou de terceiro, inclusive caso fortuito externo.

Com a redação sugerida pelo Projeto de Lei, há a necessidade de identificar se as exceções propostas são capazes de abarcar as nuances de casos cujos cenários sejam complexos. A forma de regulação que venha a ser aprovada para as aplicações de inteligência artificial deve considerar que diferentes casos concretos implicarão peculiaridades, as quais precisarão ser resolvidas conforme cada contexto.

Assim, a redação proposta pelo Projeto de Lei deve garantir que o arranjo de responsabilidade civil proposto seja capaz de abranger as nuances de casos complexos. A regulamentação de aplicações de inteligência artificial deve considerar que diferentes cenários envolverão particularidades que precisam ser tratadas de forma específica em cada contexto. Portanto, a definição da legislação nessa área requer cuidadosa ponderação para assegurar uma regulação eficiente e que permita lidar com a ampliação das aplicações de IA em diversos setores.